Deepseek 本地部署(成功版)

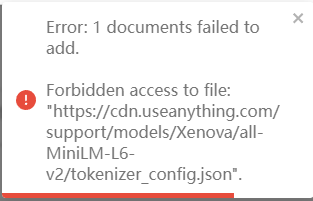

Error: 1 documents failed toadd.

Forbidden access to file:"https://cdn.useanything.com/support/models/Xenova/all-MiniLM-L6-v2/tokenizer config.json" 解决办法

跟着步骤来 肯定能成功

Ollama部署版本

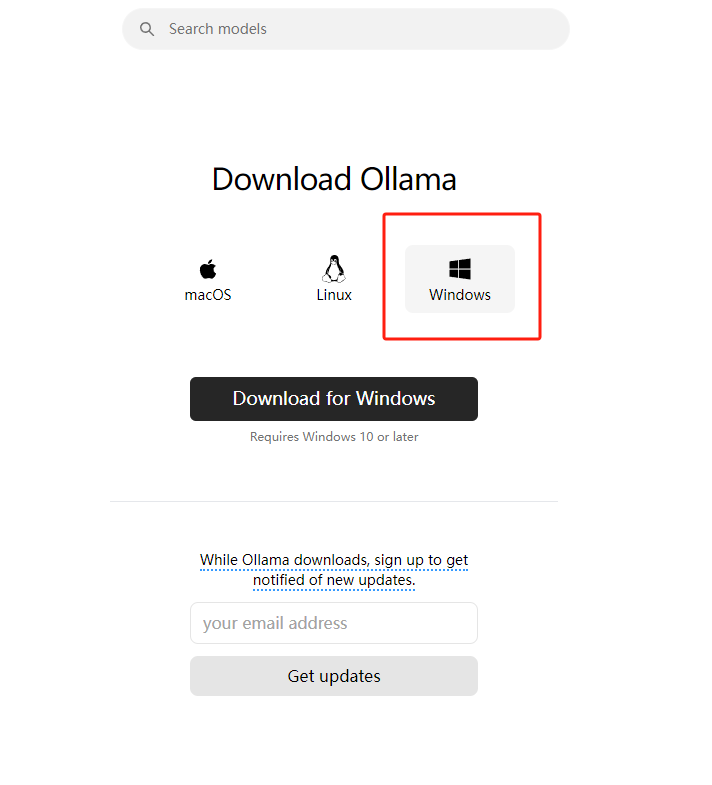

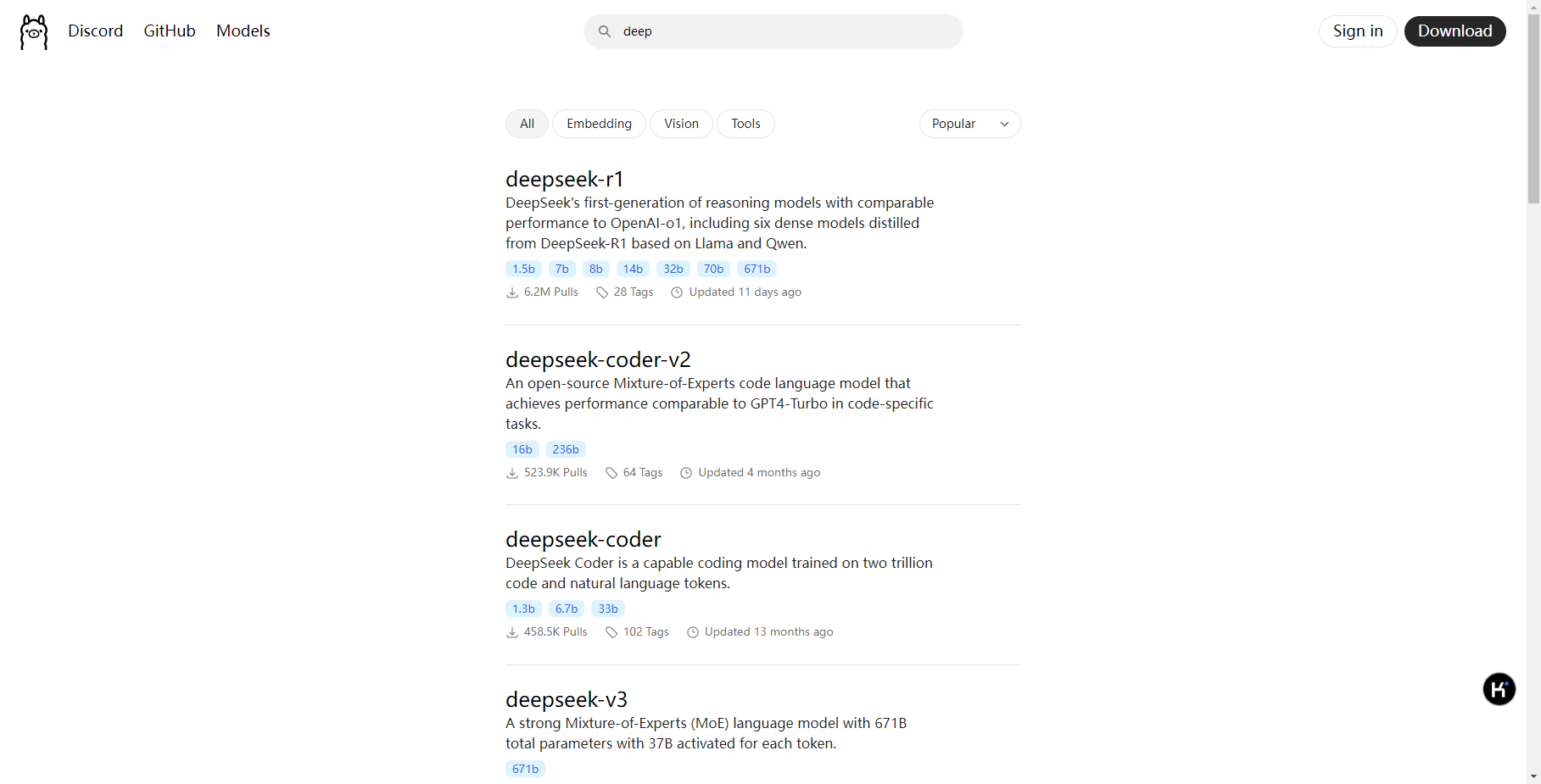

首先打开官网

直接下载Windows版本

可能有些网速不够快 , 提供下载安装版本

通过网盘分享的文件:OllamaSetup_2.exe

链接: https://pan.baidu.com/s/13cWJZZ4MDbnsYGlfetRRjQ?pwd=2hy2 提取码: 2hy2

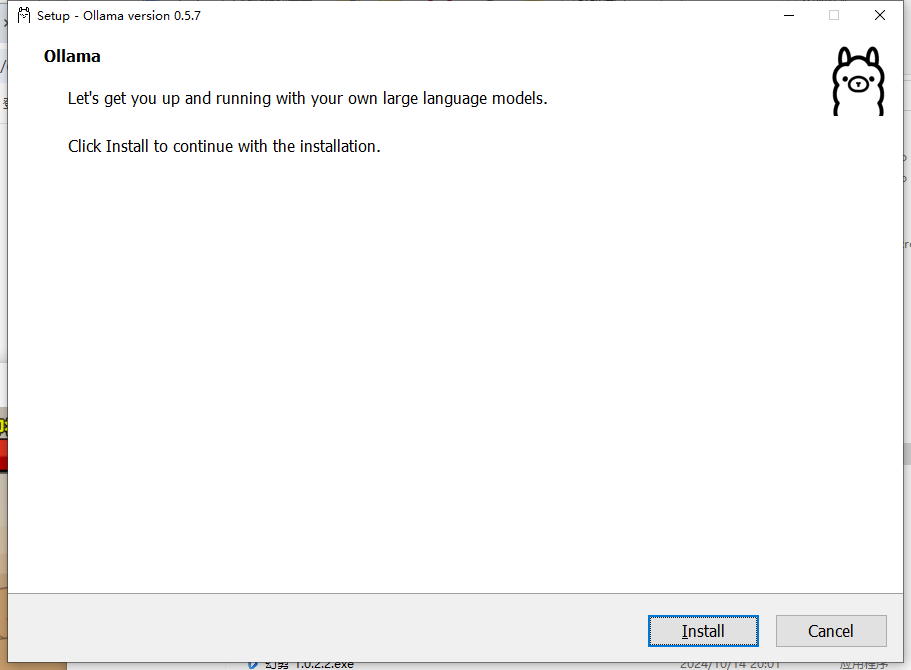

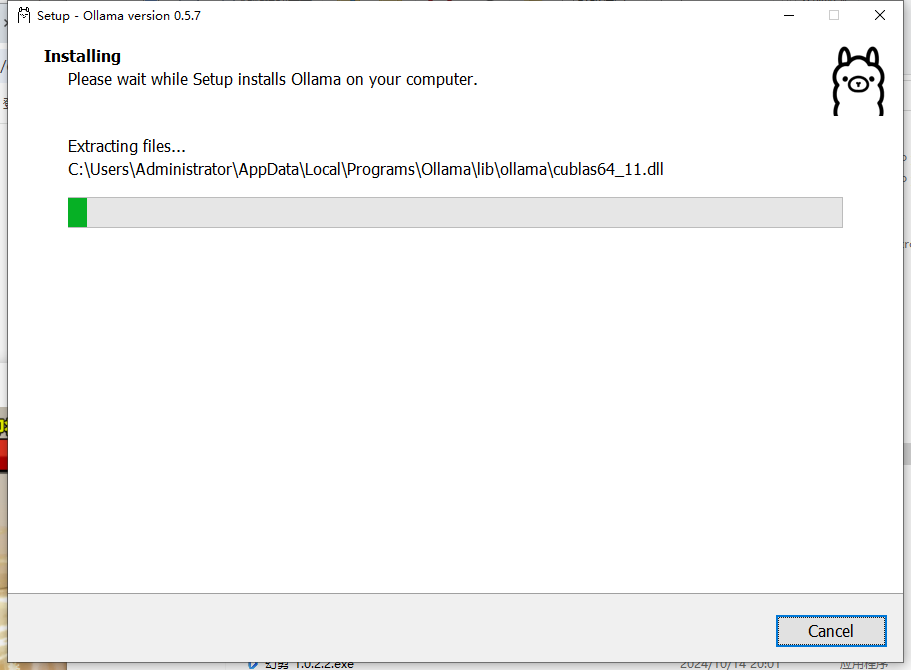

下载安装就能用

记住安装位置,到时候可能会用得上

安装完毕不会有任何提示,但实际上已经安装完毕

如果觉得C盘放模型会占地方,可以换其他的盘

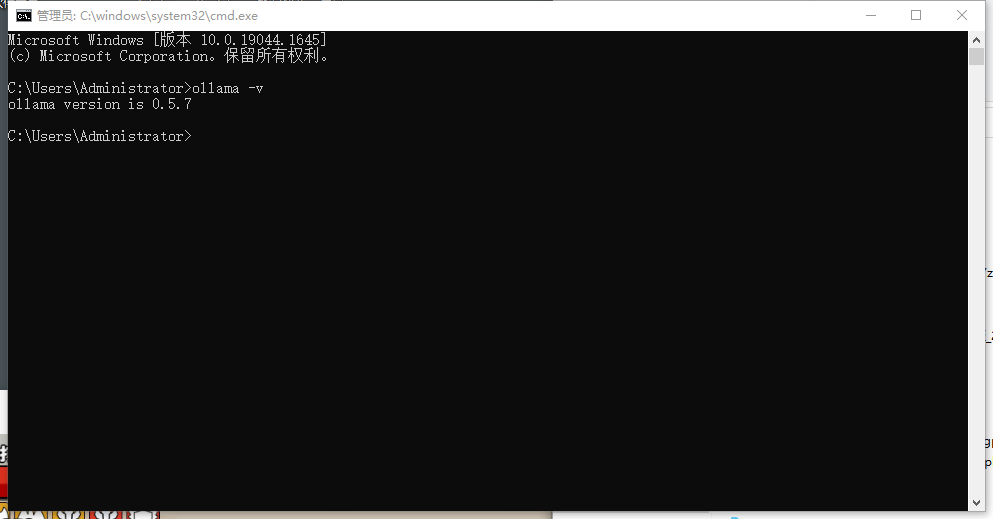

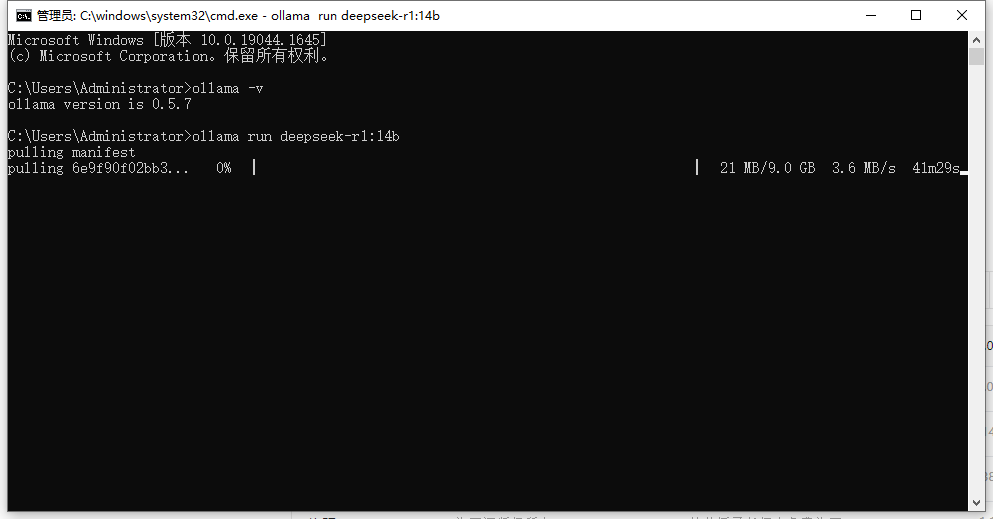

先检查一下版本

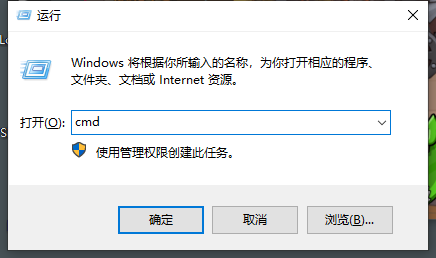

win+r

ollama -v

出现这个表示已经安装成功,此时先不要着急上模型,如果放在C盘 直接安装即可 首先退出Ollama 再操作

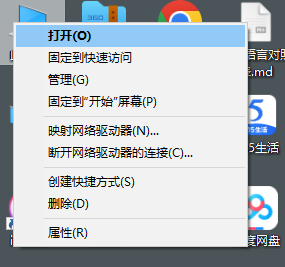

右键计算机 选择属性

不知道win10 和 win11是不是一样 但都是进入属性进行设置

右键计算机---属性---高级系统设置---环境变量

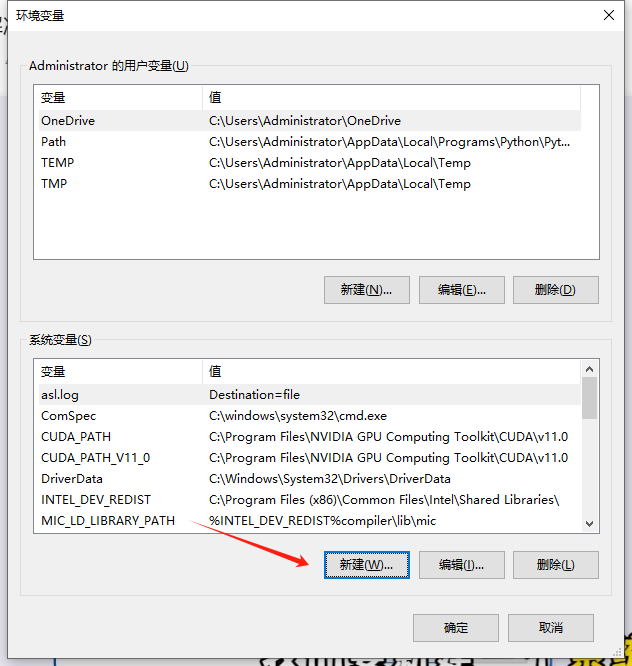

如下选择

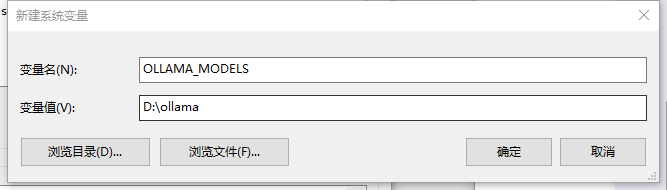

直接复制OLLAMA_MODELS

下面一行在D盘新建文件夹后直接复制路径

然后确定--确定--确定 即可

当一切准备完毕

回到ollama https://ollama.com/download

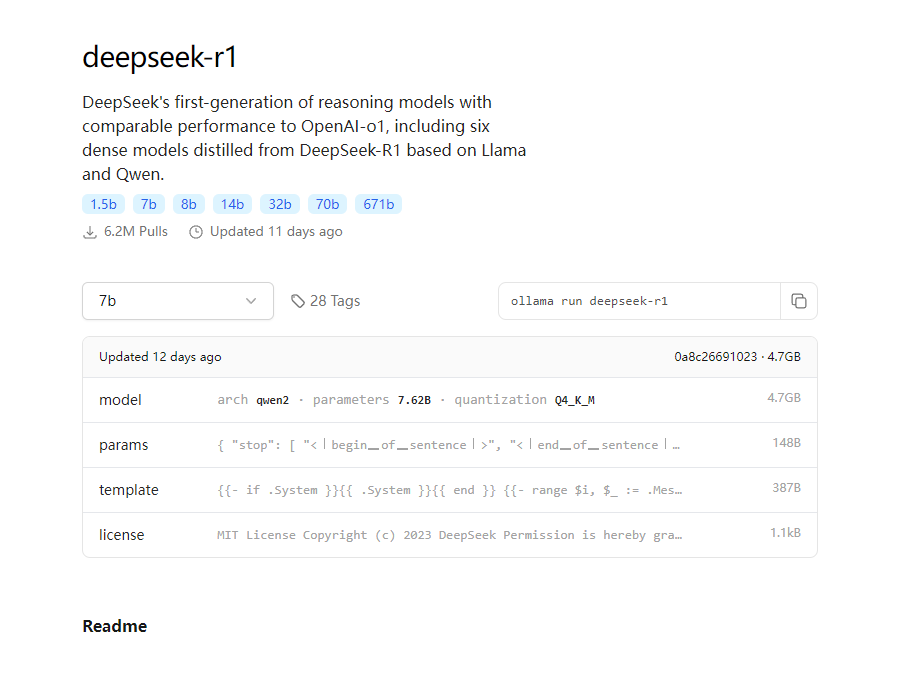

回到deepeek官网 发现深度思考是R1模型

每个模型的大小都不一样 根据自己的显卡来

4090 可以直接莽32b+

3060卡 据说14b好像是极限..

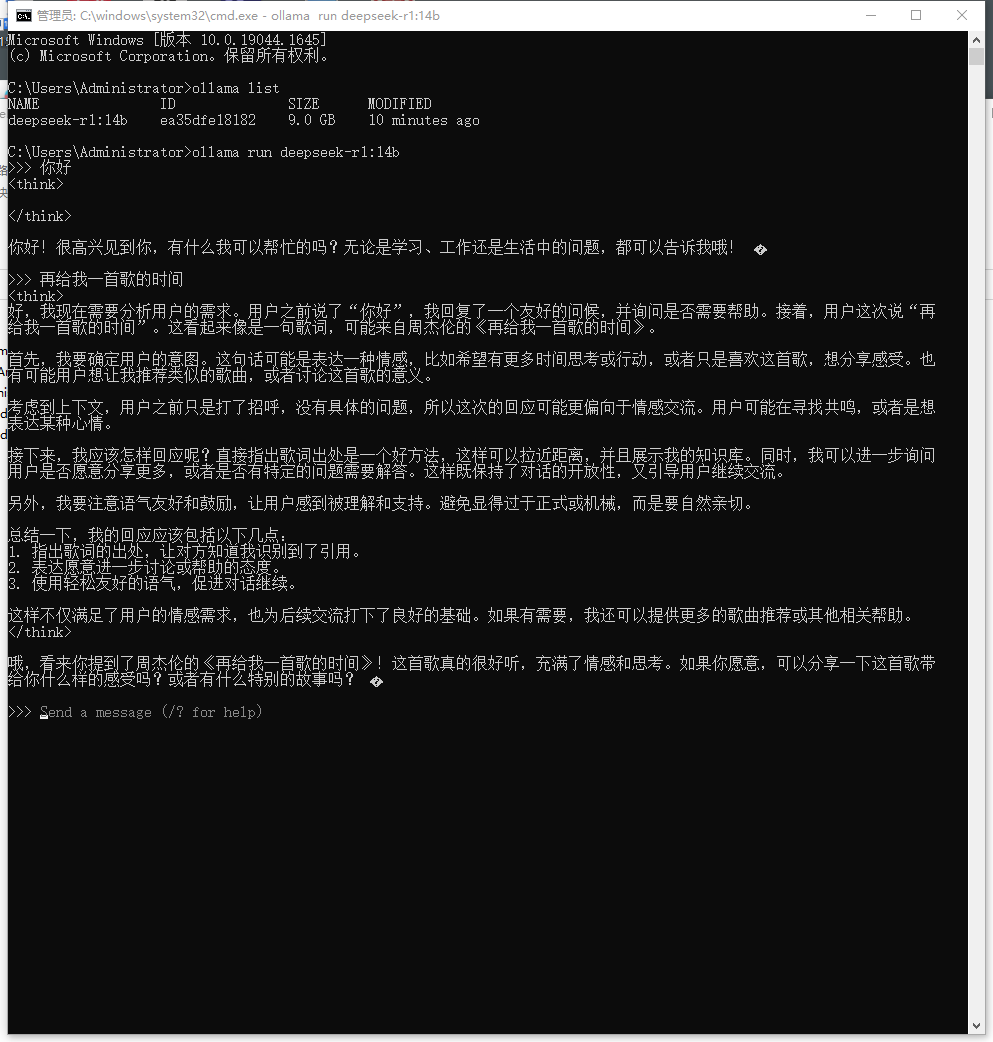

ollama run deepseek-r1:14b

然后就是漫长的过程...

百度网网盘

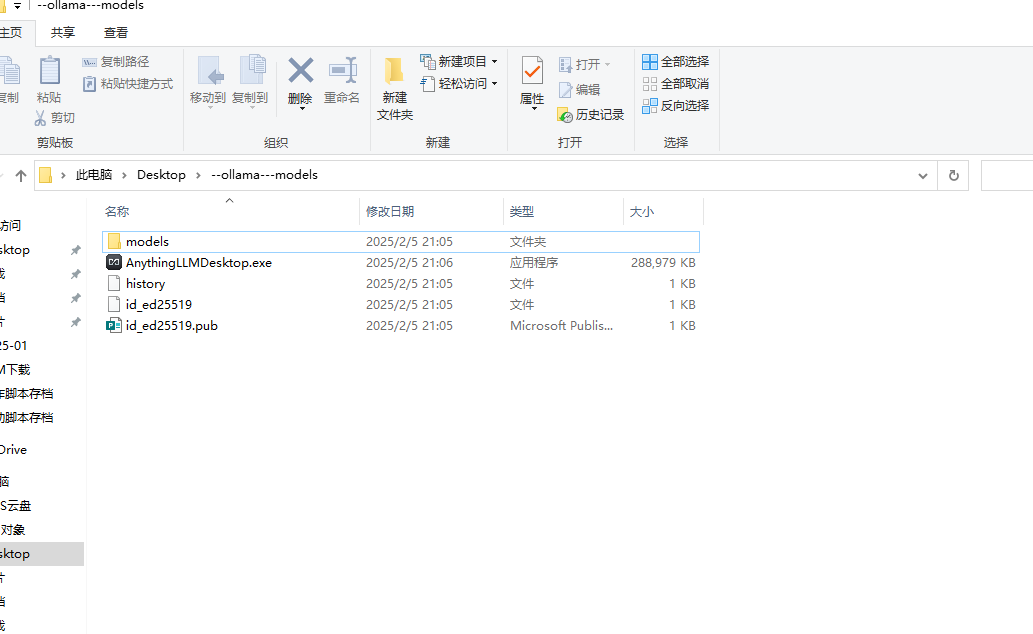

通过网盘分享的文件:--ollama---models

链接: https://pan.baidu.com/s/11VX-eDCfJg5h_I_3twcctg?pwd=vgwf 提取码: vgwf

下载好了之后 可以直接放到原始地址,也可以放到变量地址

原始地址C:\Users\Administrator\.ollama Users是自己的用户名

然后 win+r

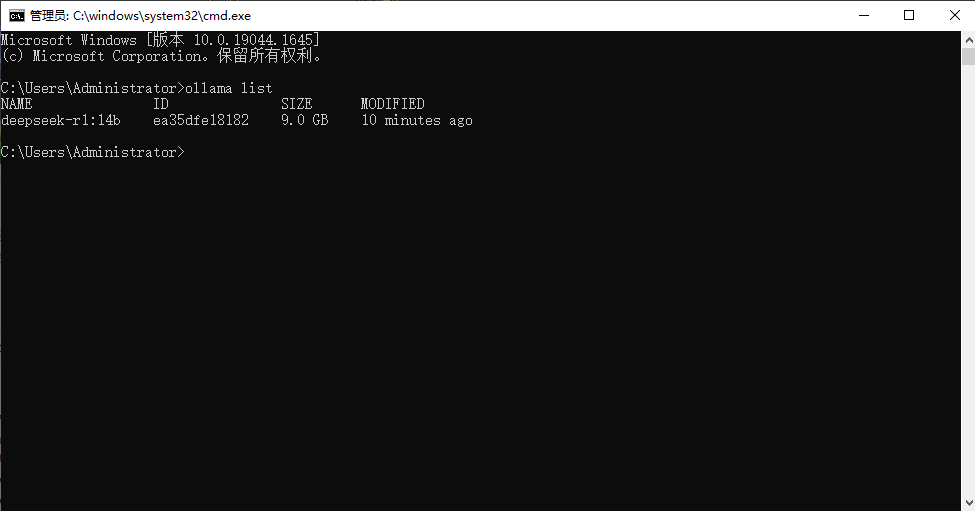

ollama list

尝试启动

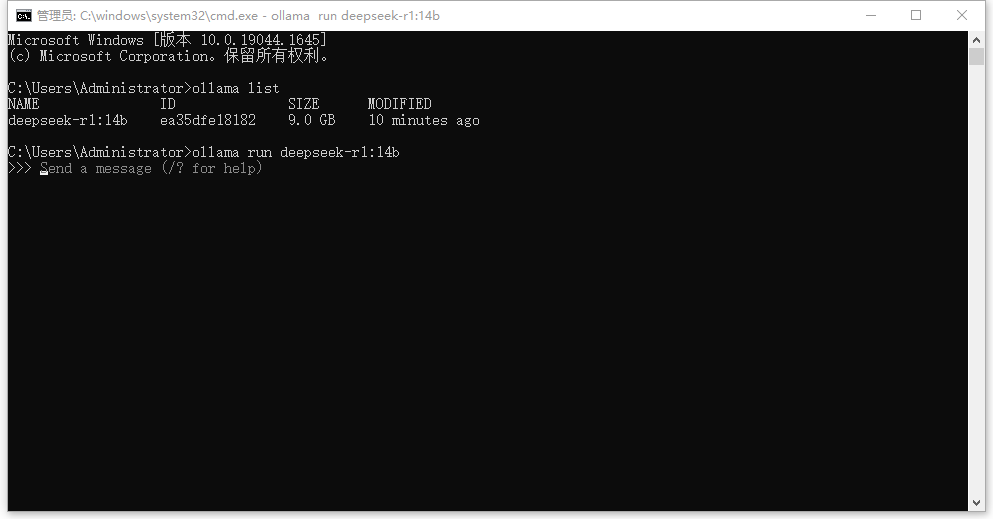

ollama run deepseek-r1:14b

出现这个

代表启动成功

完成

退出输入 /bye

需要注意的 如果放在机械硬盘里 启动可能稍微慢一点 ~

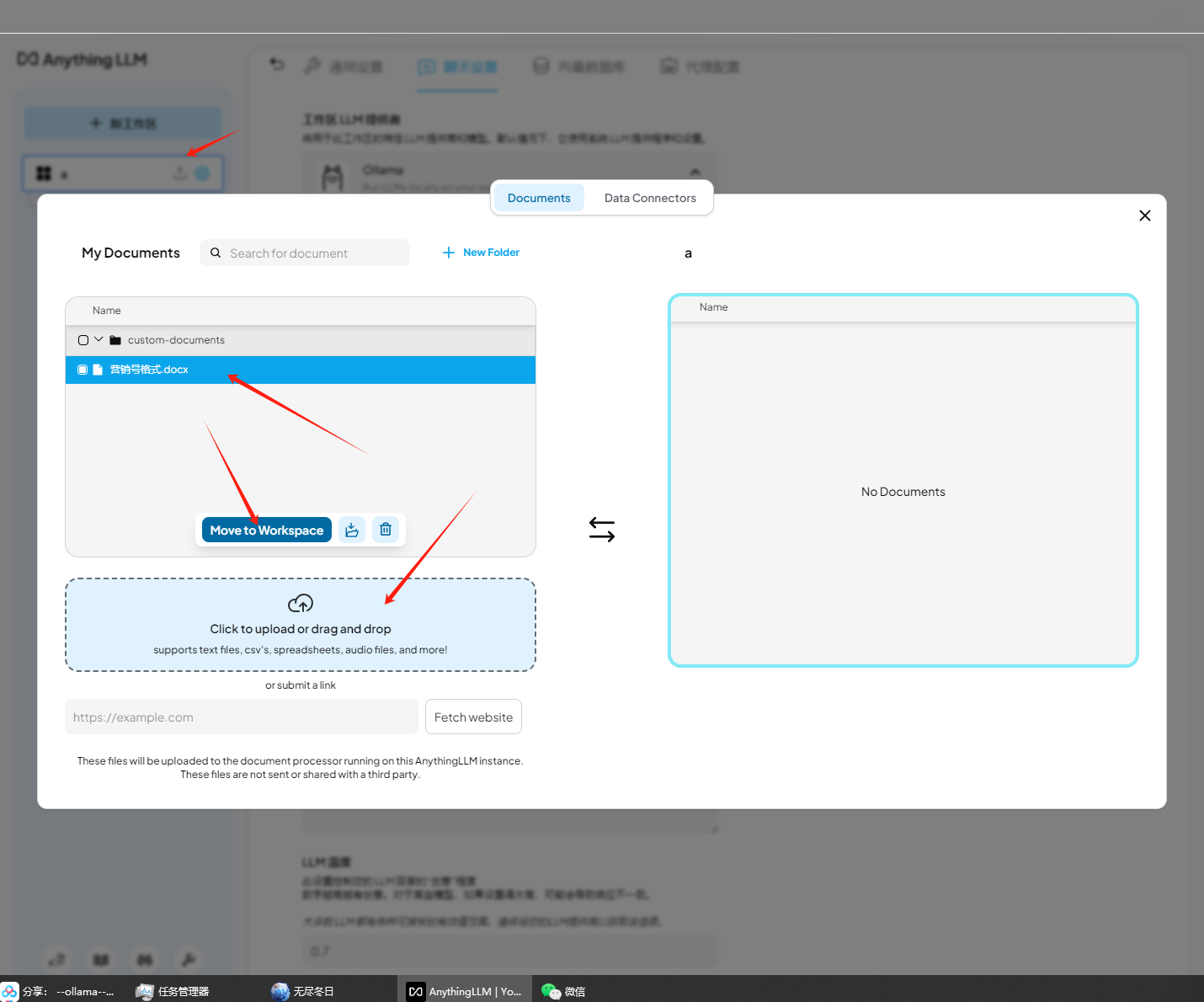

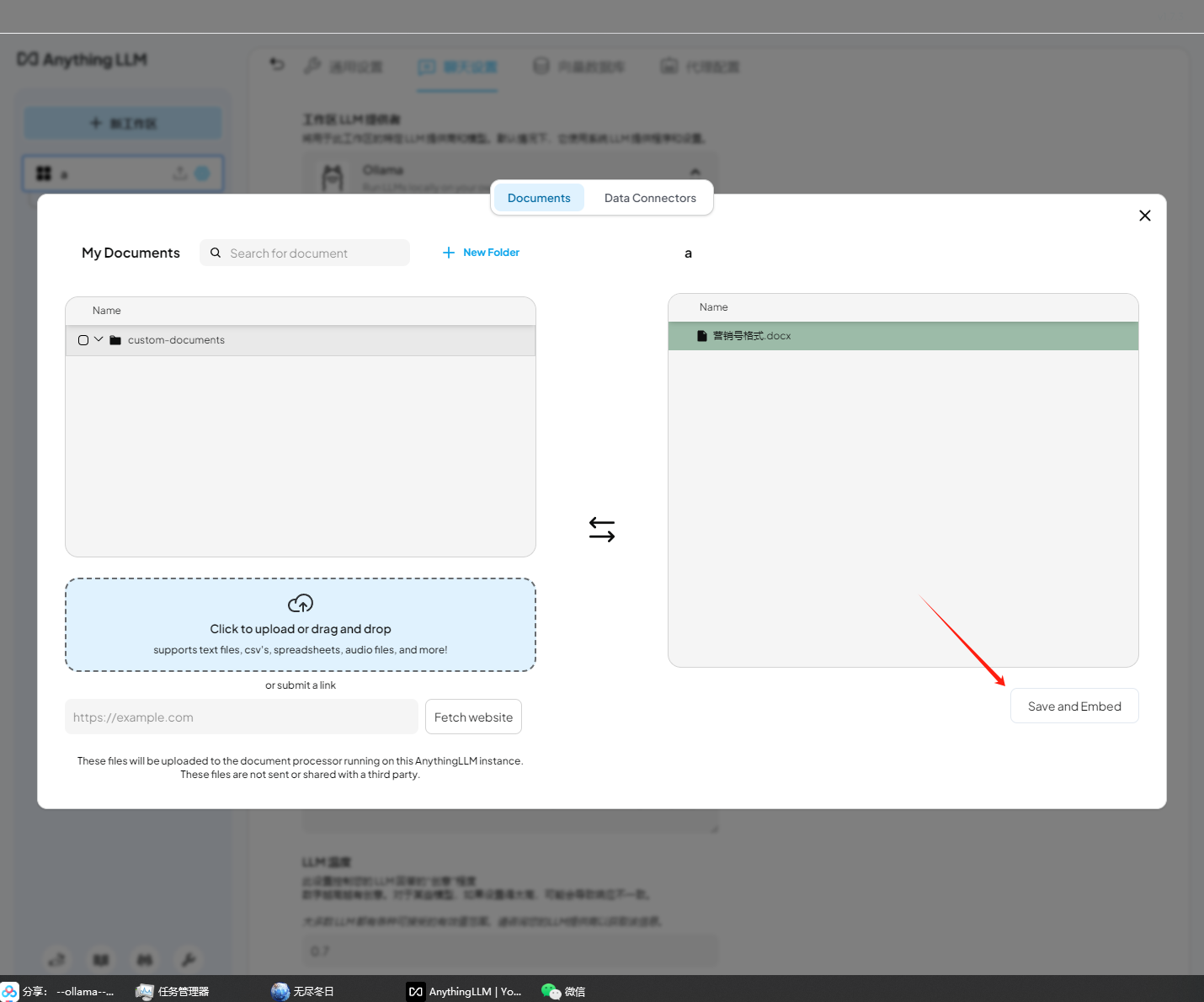

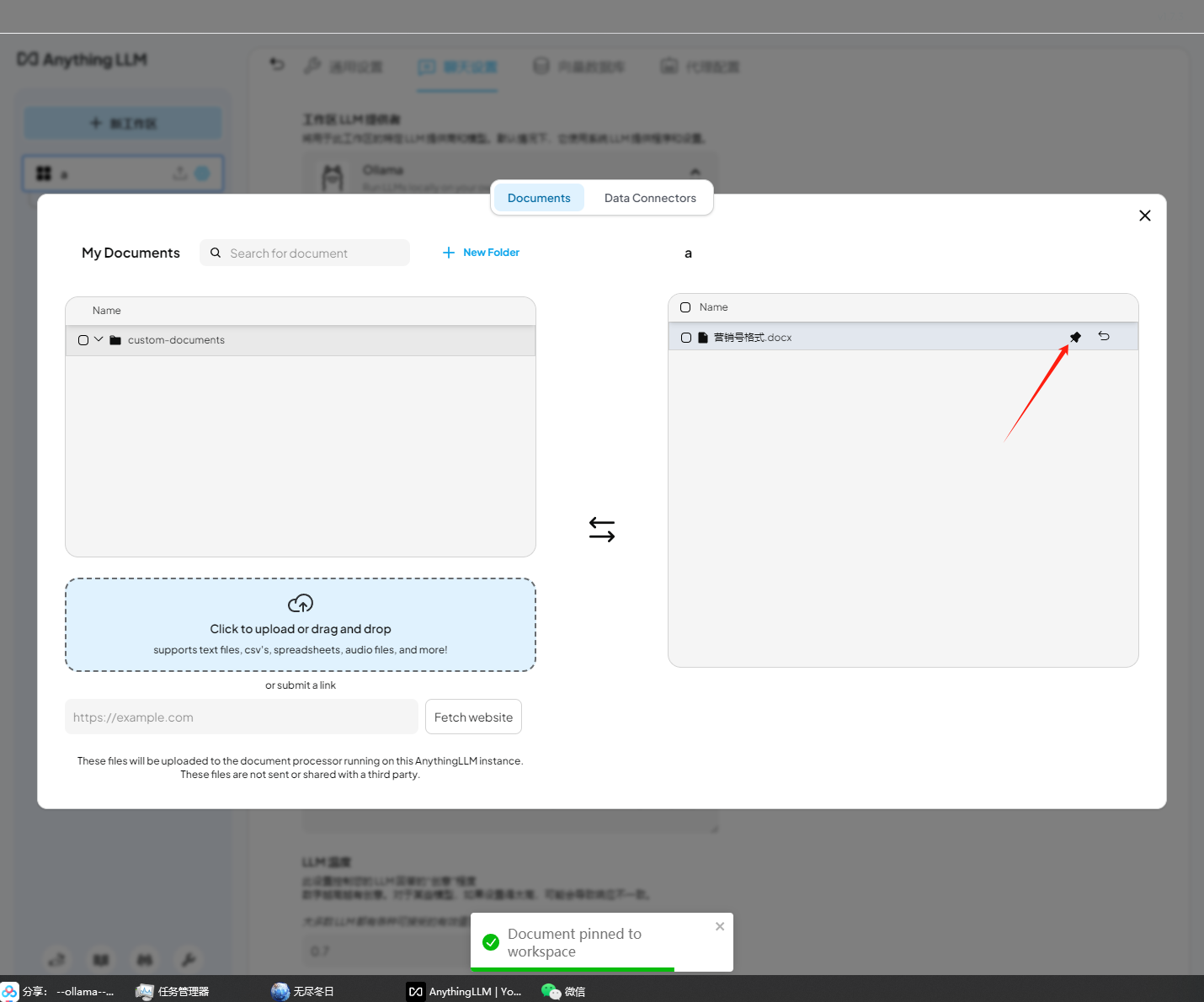

知识库

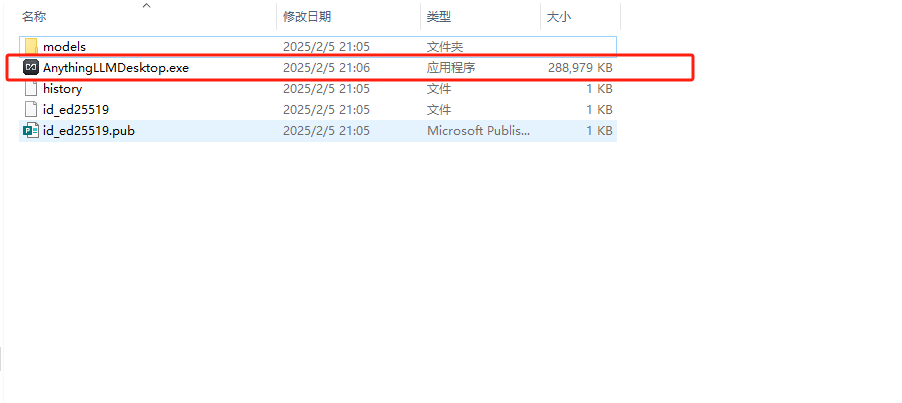

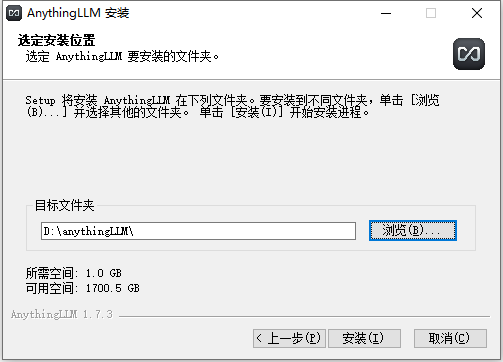

打开刚才下载的文件

进行安装

安装到哪其实都行 就看你固态够不够大

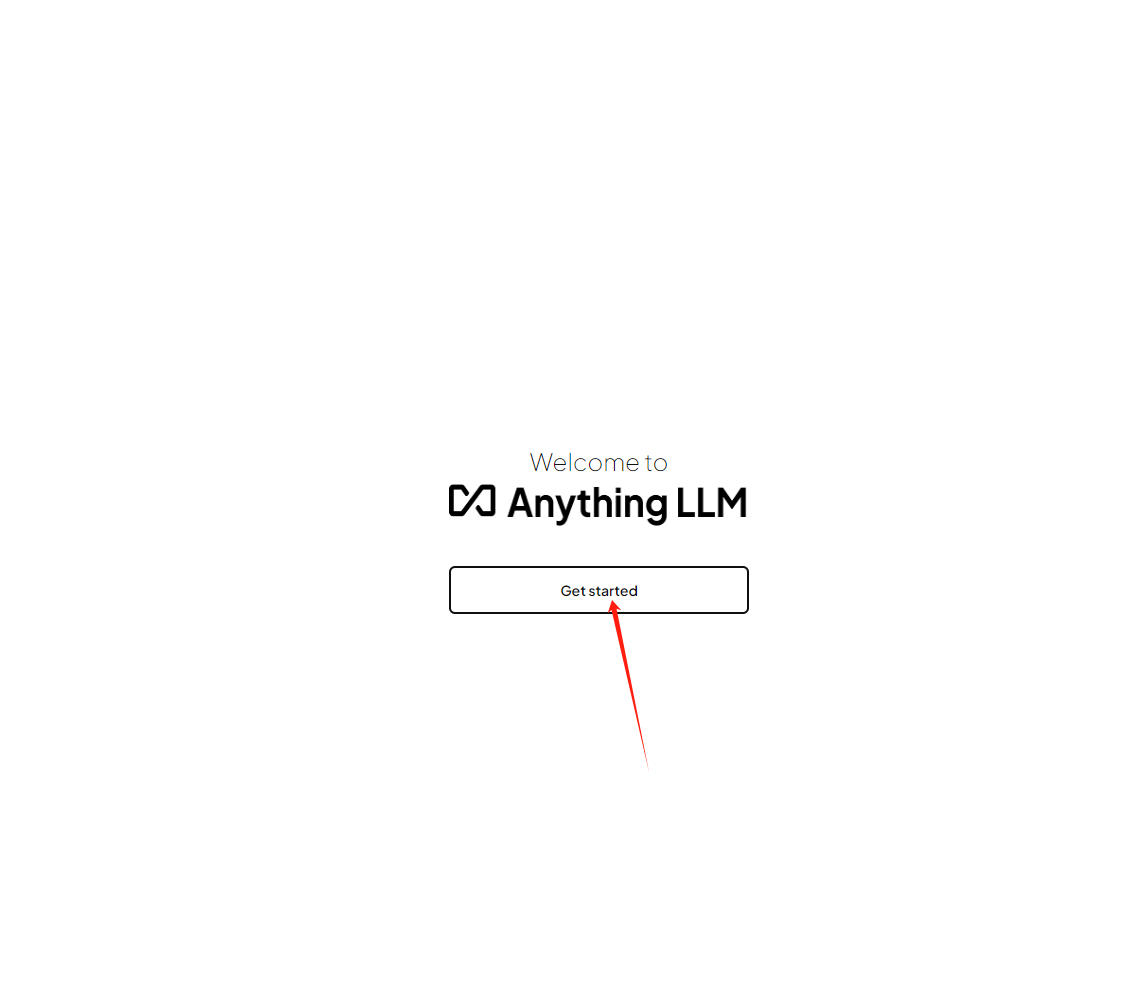

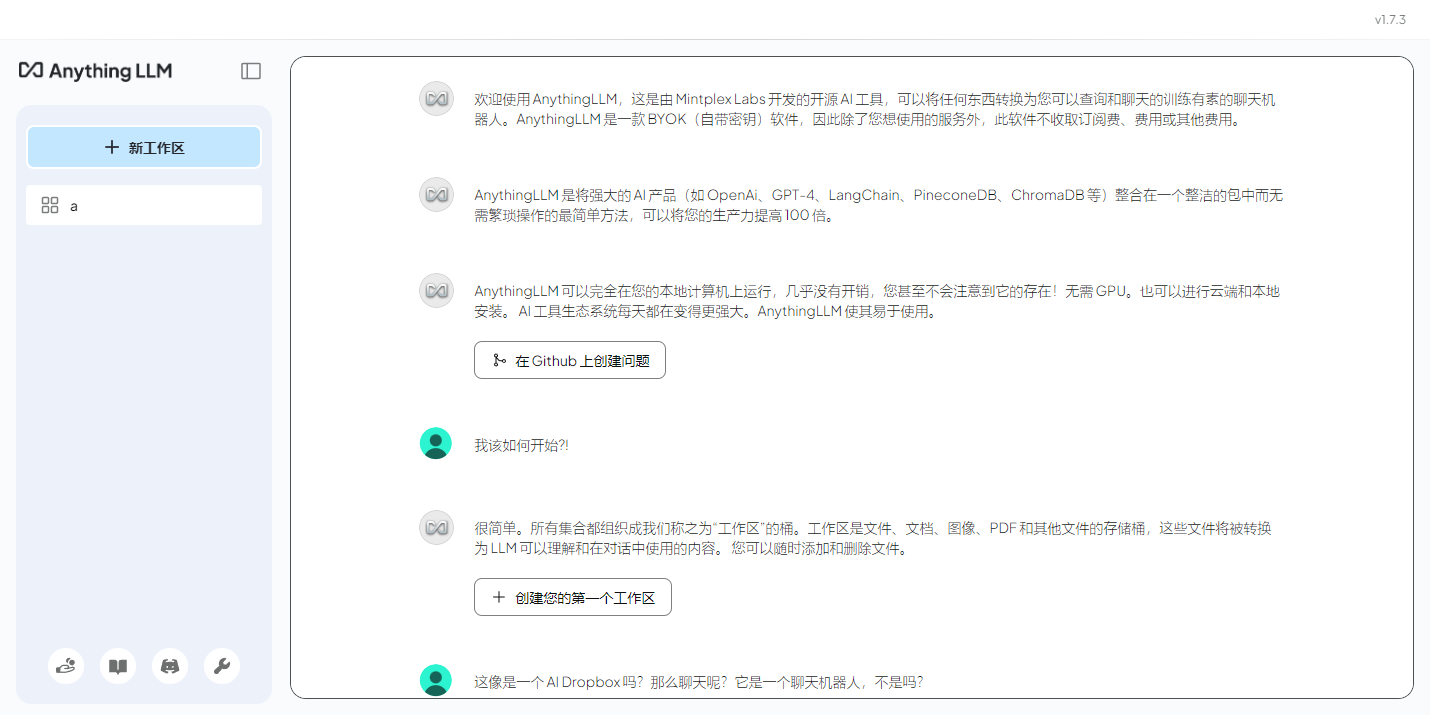

首次打开

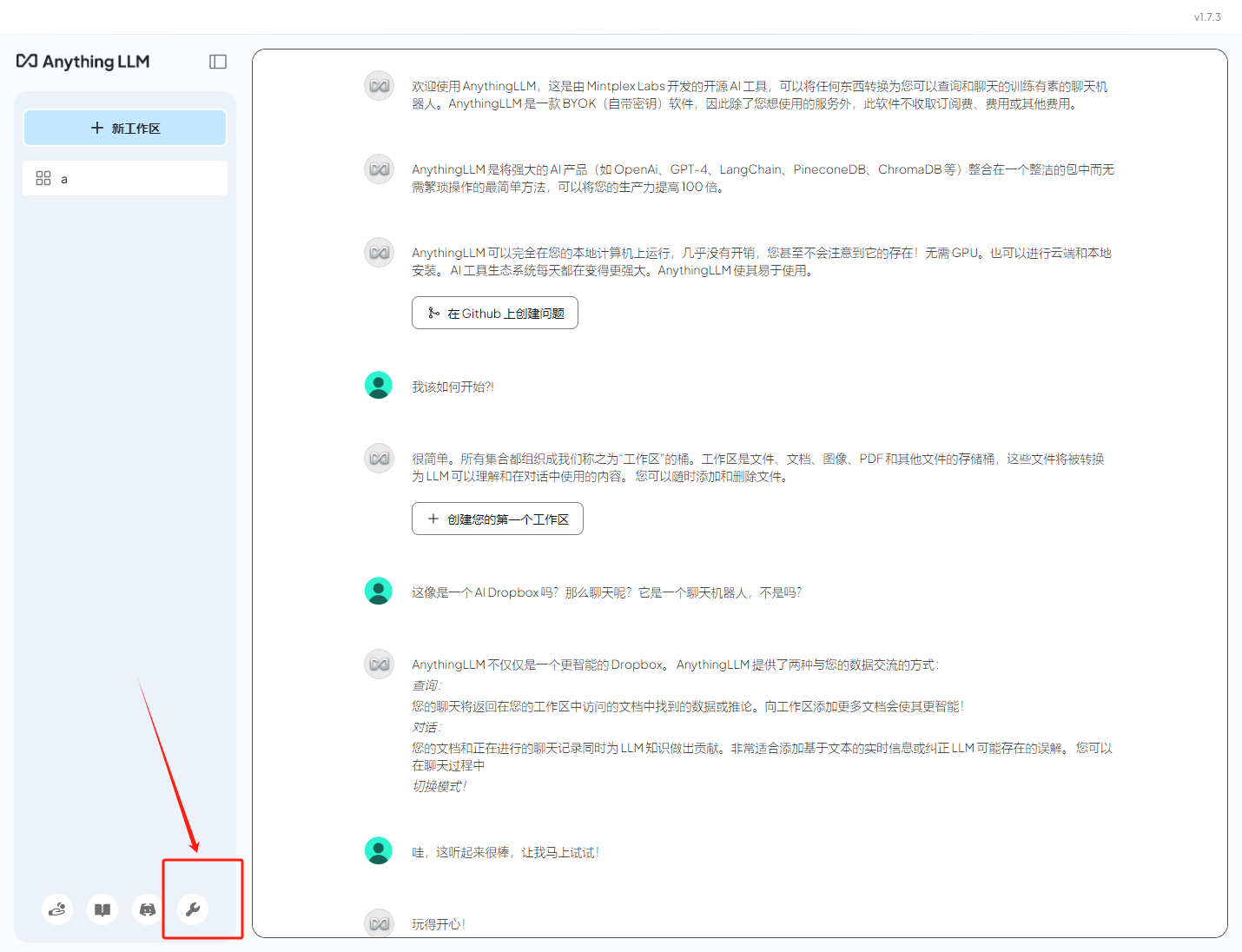

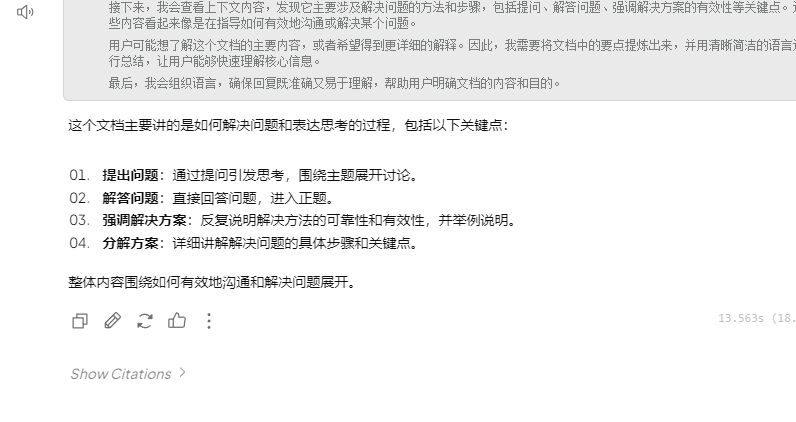

都完事了 进入到这个界面

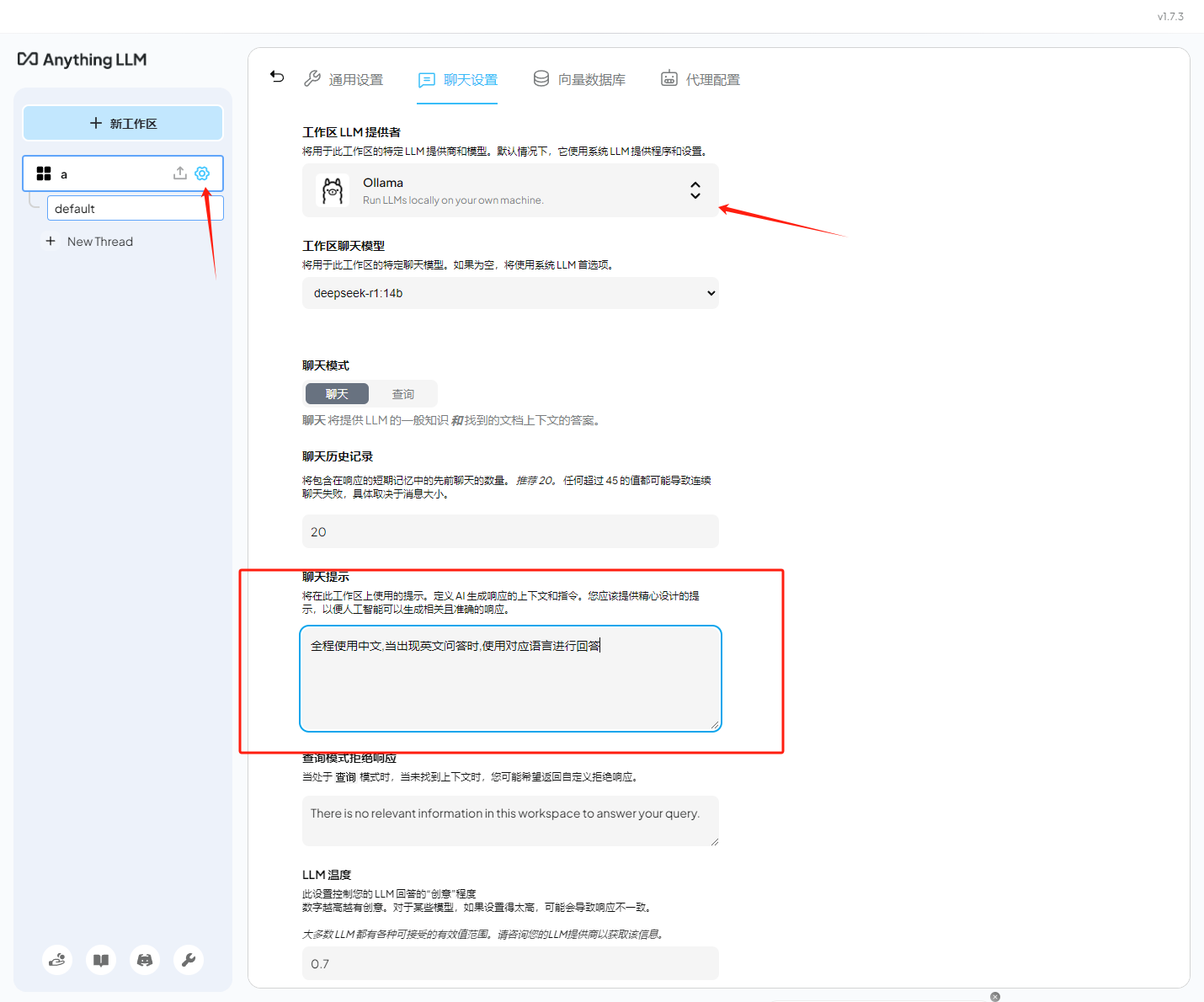

简单设置一下

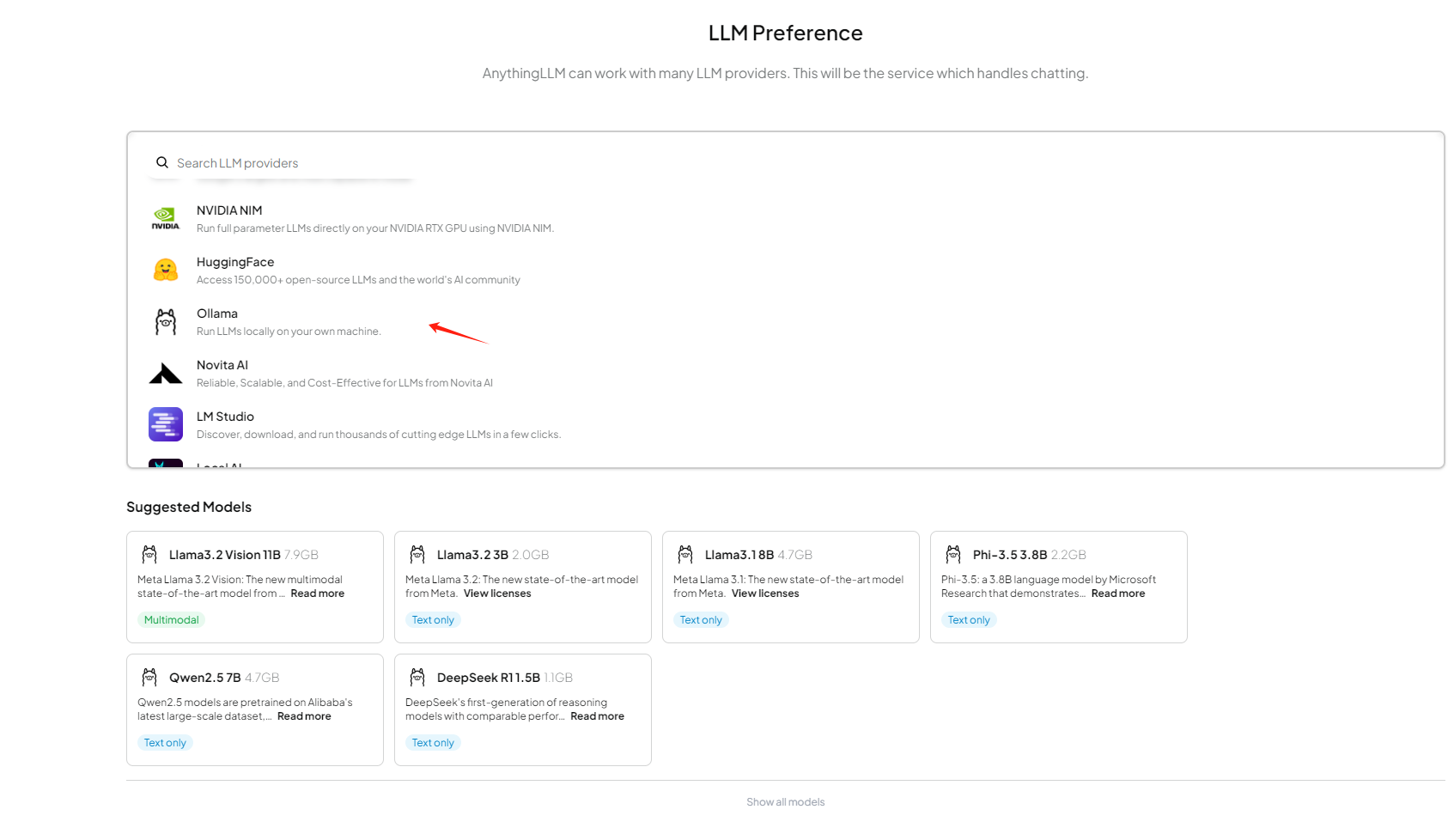

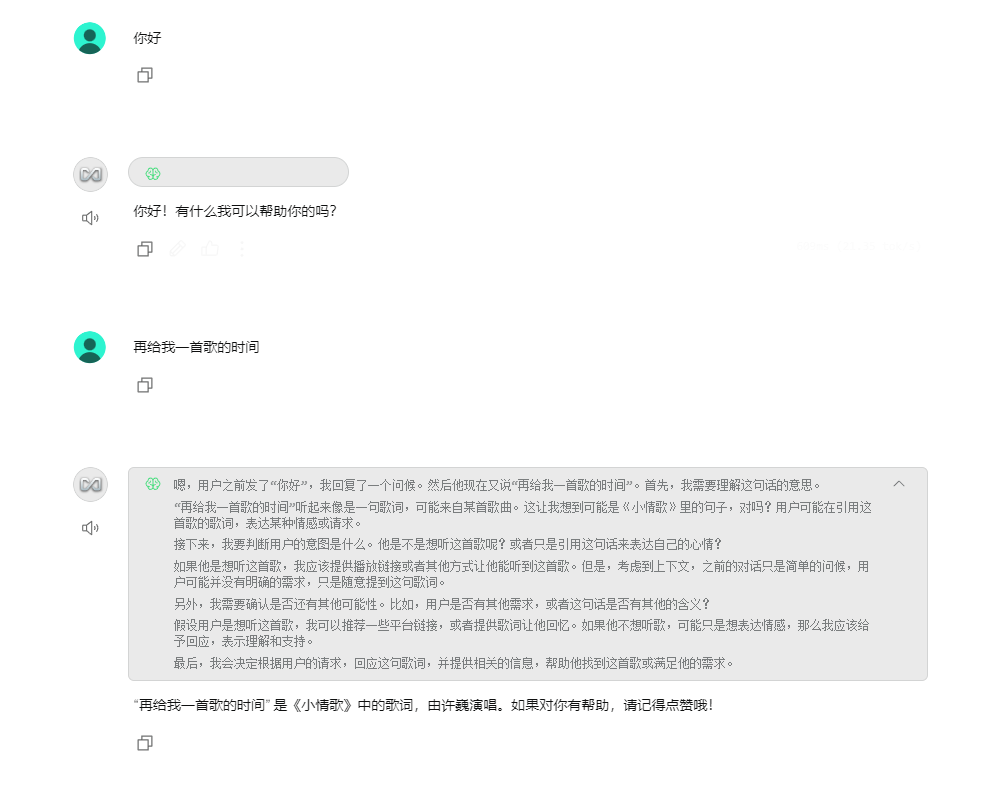

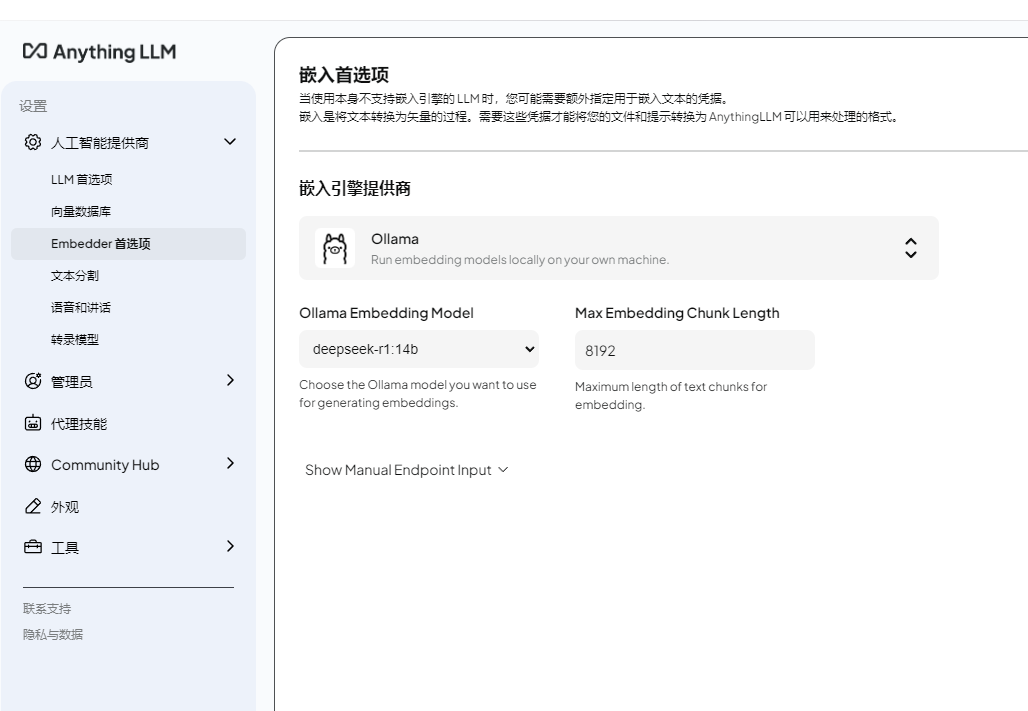

这个地方

再进行简单设置

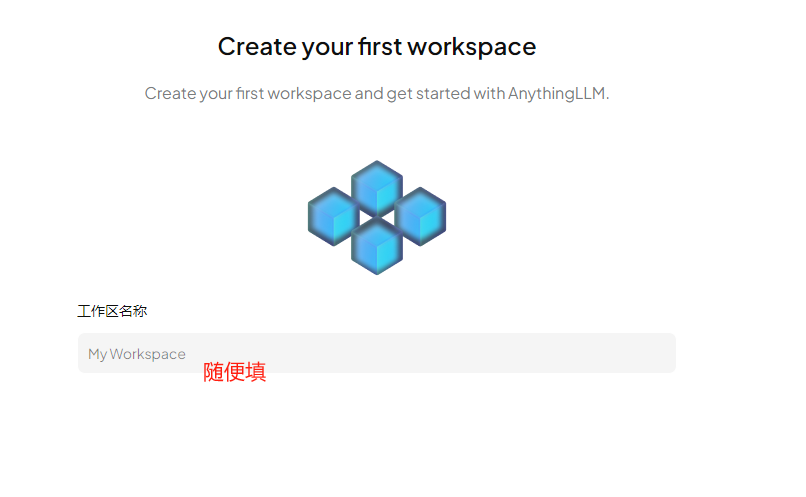

然后

当出现

挂个梯子就好了

或者直接把文档扔进去都行

下课!

注意 回答的质量完全取决于你知识库的丰富程度

评论区(暂无评论)